IT之家 4 月 23 日消息,小米今日宣布,Xiaomi MiMo-V2.5 系列模型正式开启公测。MiMo-V2.5-Pro 和 MiMo-V2.5 模型即将全球开源。

IT之家从公告获悉,Xiaomi MiMo-V2.5 系列包含 MiMo-V2.5、V2.5-Pro 、V2.5-TTS Series 、V2.5-ASR,拥有更强的推理、更稳的 Agent、更长的上下文、更强的指令遵循与模糊指令理解、更好的全模态感知和理解。与此同时,小米也对 Token Plan 定价方案进行了优化。

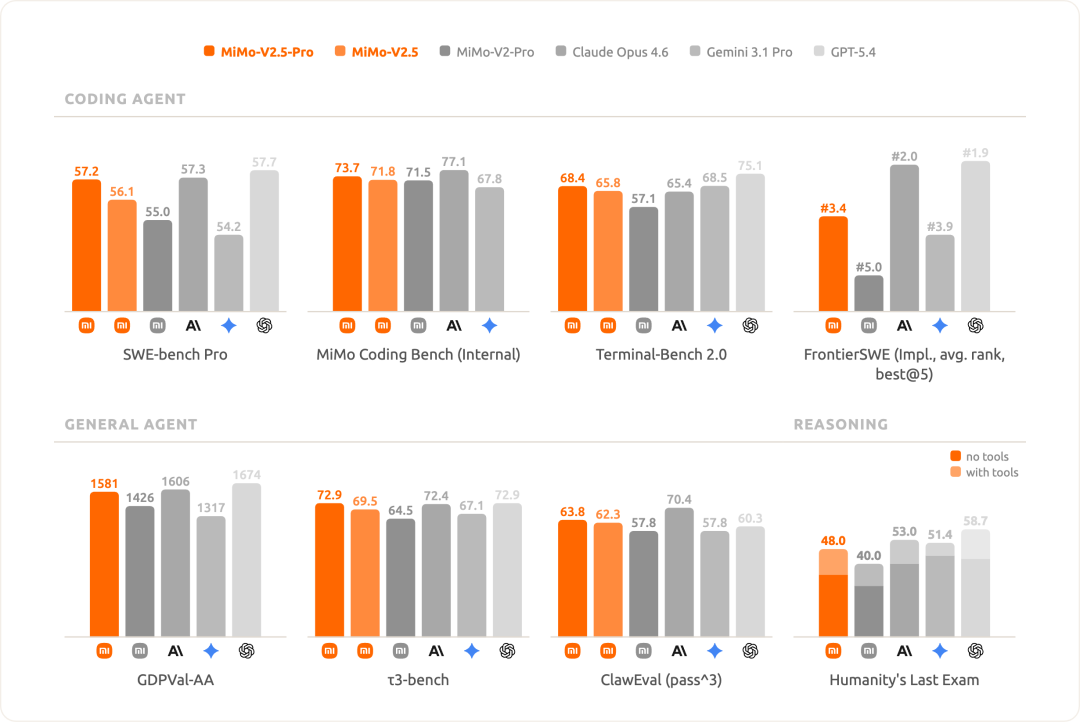

据介绍,MiMo-V2.5-Pro 是小米迄今最强大的模型。在通用 智能体 能力、复杂软件工程以及长程任务等维度上,它已能与全球顶尖 Agent 模型(Claude Opus 4.6、GPT-5.4 )正面较量,相较上一代 MiMo-V2-Pro 实现了全方位跃升。

内部测试中,MiMo-V2.5-Pro 搭配合适的运行框架,它可以稳定完成单次涉及近千轮工具调用的长程任务,在智能体场景下的指令遵循能力也明显提升 —— 既能精准捕捉上下文中的隐性要求,又能在超长周期内保持逻辑一致。至此,MiMo-V2.5-Pro 已经可以以更高的置信度承担起真正严肃的专业工作。

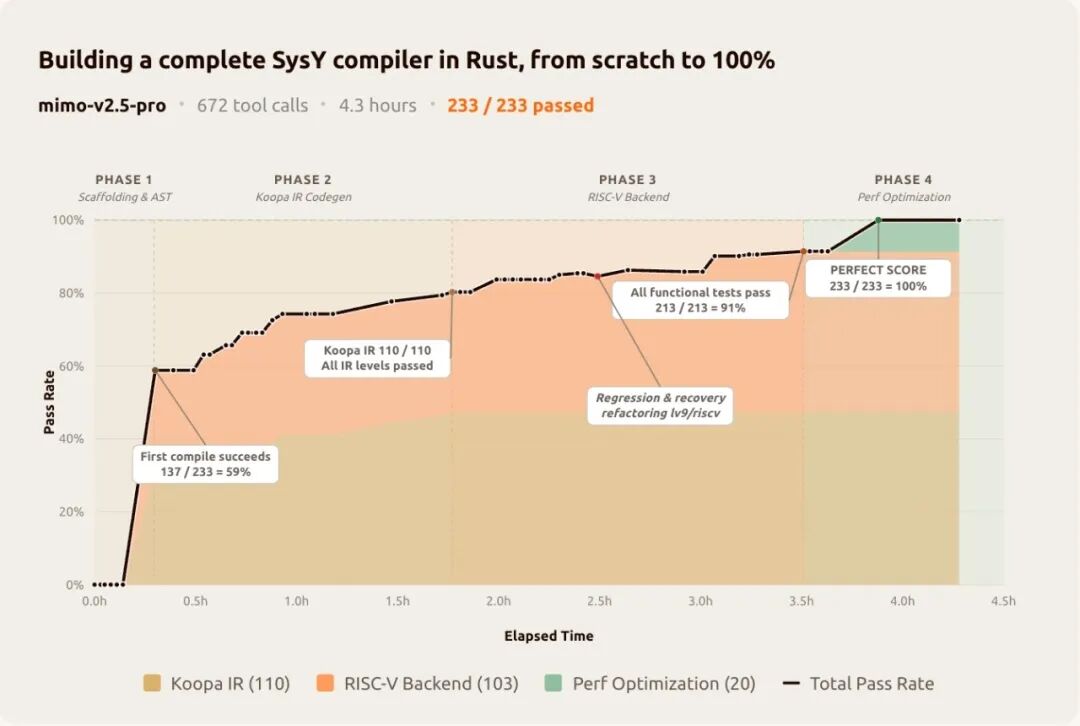

MiMo-V2.5-Pro 为更高难、更复杂的任务目标而生。小米把那些需要人类专家数天、乃至数周才能完成的任务交给它,让它独立跑完长程,且仍然可以保持极高质量。以下是它交付的结果:

该任务源自北京大学《编译原理》课程项目,要求模型用 Rust 从零实现一个完整的 SysY 编译器:词法分析器、语法分析器、AST、Koopa IR 代码生成、RISC-V 汇编后端,以及性能优化。作为参考,北大本科生完成该项目通常需要 数周 时间 ,然而 MiMo-V2.5-Pro 用时 仅 4.3 小时、经过 672 次工具调用完成全部工作,在隐藏测试集上取得 233/233 的满分 ,展现了极高效的生产力价值。

它没有陷入反复试错的蛮力,而是逐层搭建整个编译器:先搭完整流水线骨架,再逐层攻克 —— Koopa IR 满分(110/110),RISC-V 后端满分(103/103),性能优化满分(20/20)。首次编译即通过 137/233,59% 的冷启动通过率,意味着在跑任何测试之前,架构就已经是对的了。第 512 轮,一次重构令 lv9/riscv 回退了两个测试点;模型自行诊断、恢复、继续推进。

仅凭几句简单指令 ——” 构建一个视频编辑器 Web 应用 “——MiMo-V2.5-Pro 便交付了一款可运行的 Web 应用:具备多轨道时间线、片段裁剪、交叉淡化、音频混合以及导出流程等功能。最终构建的代码量达 8,192 行,历经 1,868 次工具调用,在 11.5 小时的自主工作中完成。

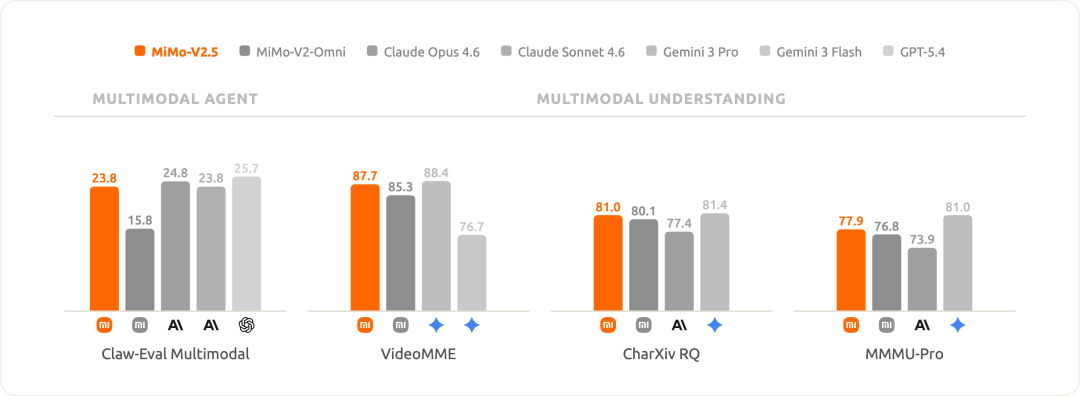

MiMo-V2.5 是为 Agent 场景而生的原生全模态大模型,能同时看、听、读,并把理解转化为行动。这一次,MiMo-V2.5 带来个关键升级:

Agent 能力全面超越 MiMo-V2-Pro

在 Claw-Eval 等权威 Agent 评测中,MiMo-V2.5 超过 MiMo-V2-Pro 水平,胜任日常简单任务,同时 API 成本降低约 50%。

多模态 感知全面超越 MiMo-V2-Omni

跨模态推理、视频理解、图表分析等能力提升,在 VideoMME、CharXiv、MMMU-Pro 等评测中逼近甚至超越业界顶级闭源模型。

MiMo-V2.5 全系列针对 Token 效率进行优化,用更少的 Token 做更多的事。

在达到相同 Agent 基准榜单 ClawEval 分数情况下:

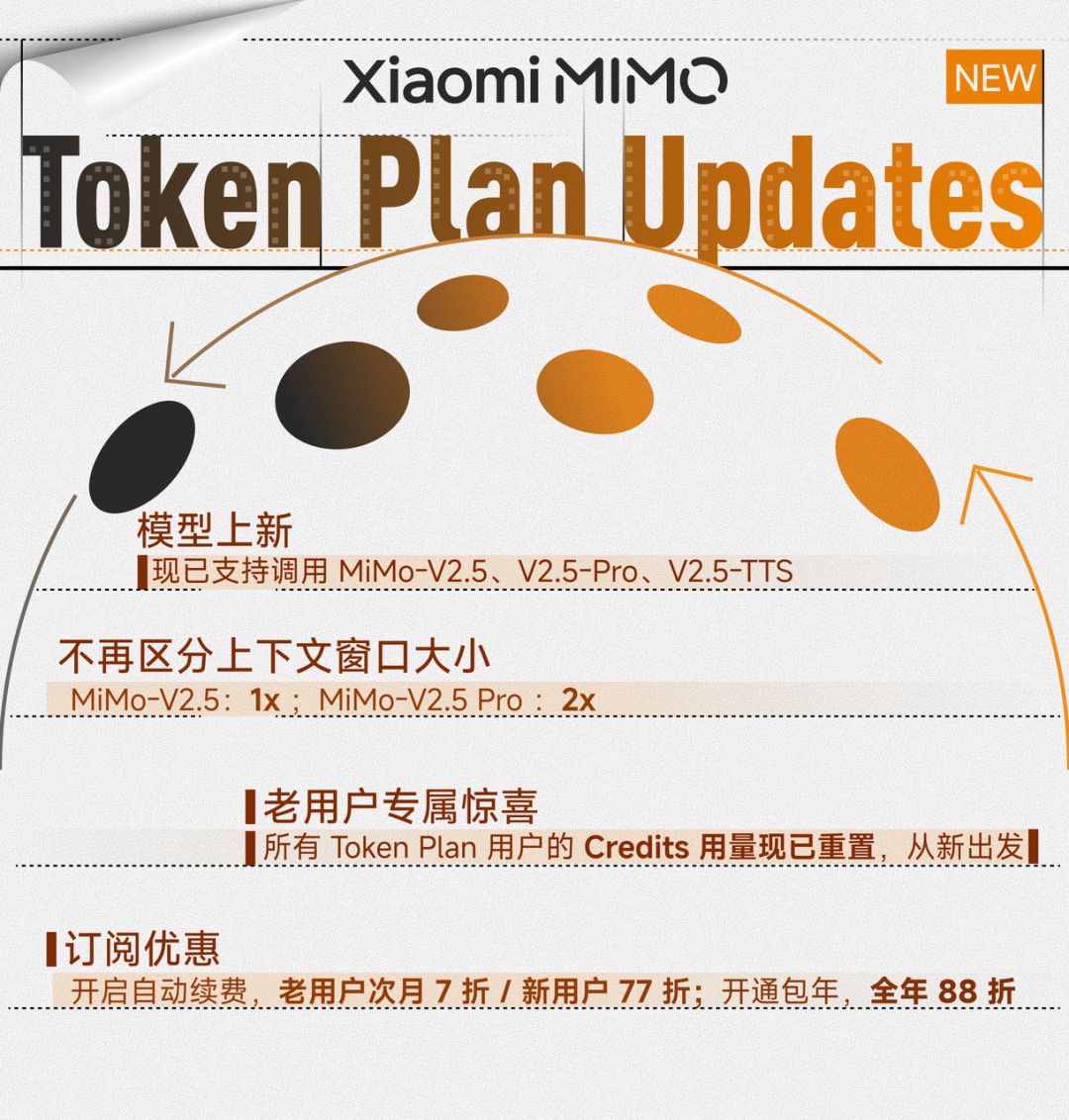

Token Plan 焕新 升级

我们针对 Token Plan 做了几项适合你的、实质性的优化:

Credits 速率更新 ,更优惠

取消 1 Token = 4 Credits 计费方式,从现在起,Token Plan 不再区分 256k 和 1 M 上下文 窗口的 Credit 倍率。

夜间专属优惠 速率

北京时间每天 00:00 ~ 08:00,所有模型 Credits 消耗速率在原有基础上再打 8 折。

自动续费享折扣

所有已购买 Token Plan 用户(截至北京时间 4 月 22 日 22:00 前)的 Credits 额度将 全部重置 清零,重新开始计算。

参考

<!-- 非定向300*250按钮 17/09 wenjing begin --> <!-- 非定向300*250按钮 end -->

</div>