来源:36氪

奥特曼发出家人和孩子的照片,并且发出长文表示,AGI如今已经如同魔戒一般,让人做出疯狂的举动。

]article_adlist–>

编辑 | Aeneas 好困

]article_adlist–>

封面来源 | AI生成

奥特曼家被炸了!

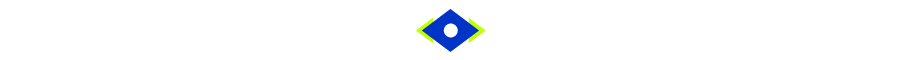

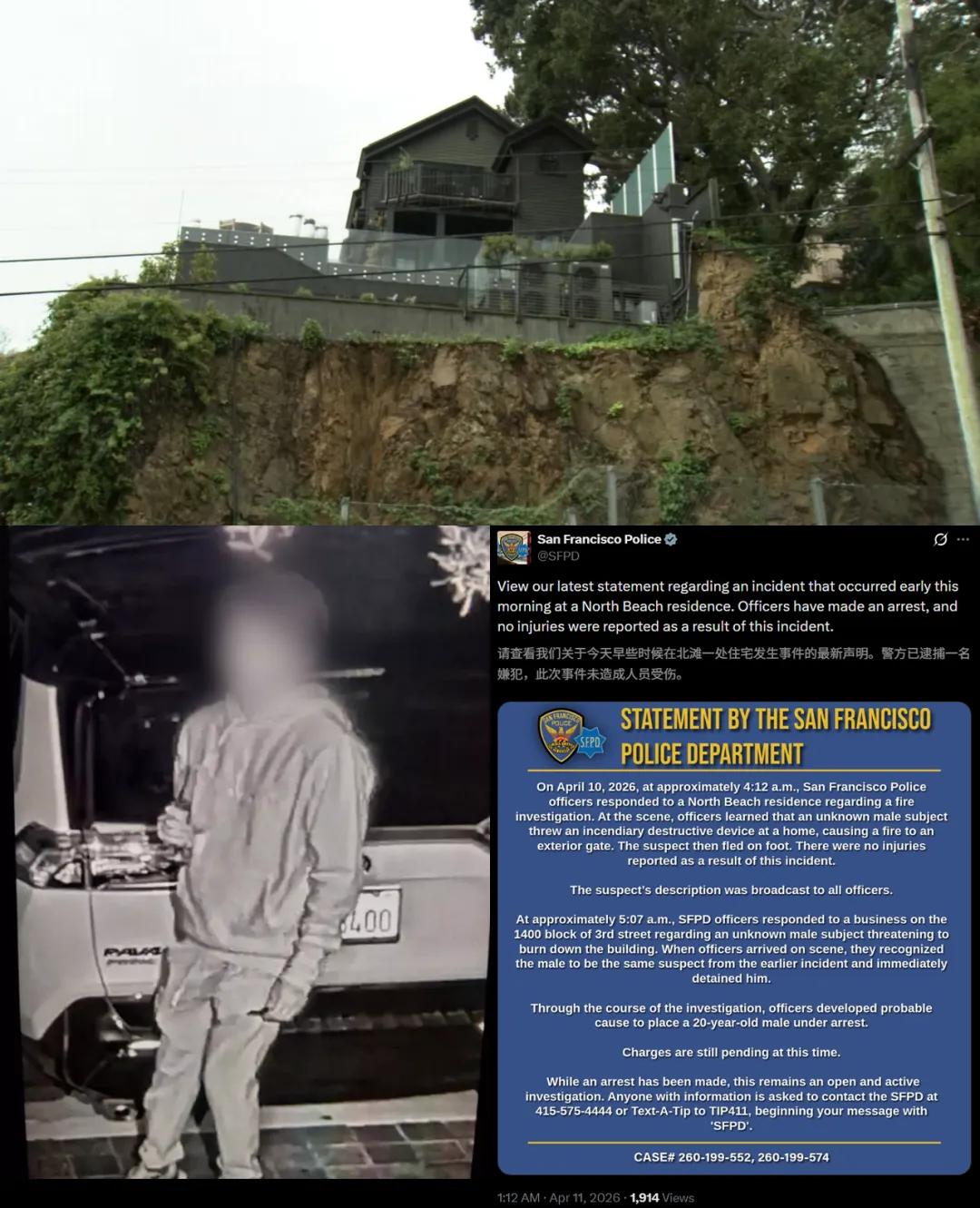

就在当地时间周五清晨,一名20岁男子向奥特曼旧金山中投掷了燃烧弹,引起火灾。

这栋豪宅价值2700万美元。

凌晨4点12分,警方接到报警,调查后发现无人受伤,火势已被控制。但嫌疑人已经徒步逃跑,体貌特征已被通报。

凌晨5点07分左右,警方又接到报警称,OpenAI办公楼外,一名身份不明的男子扬言要烧毁大楼。

警员很快发现,该男子与向奥特曼家中投掷燃烧弹的嫌疑人特征相符,应为同一人,警方立即将其拘留。

现在,旧金山警察局已经在X上发布通报。目前调查仍在进行中,尚未正式提出指控。

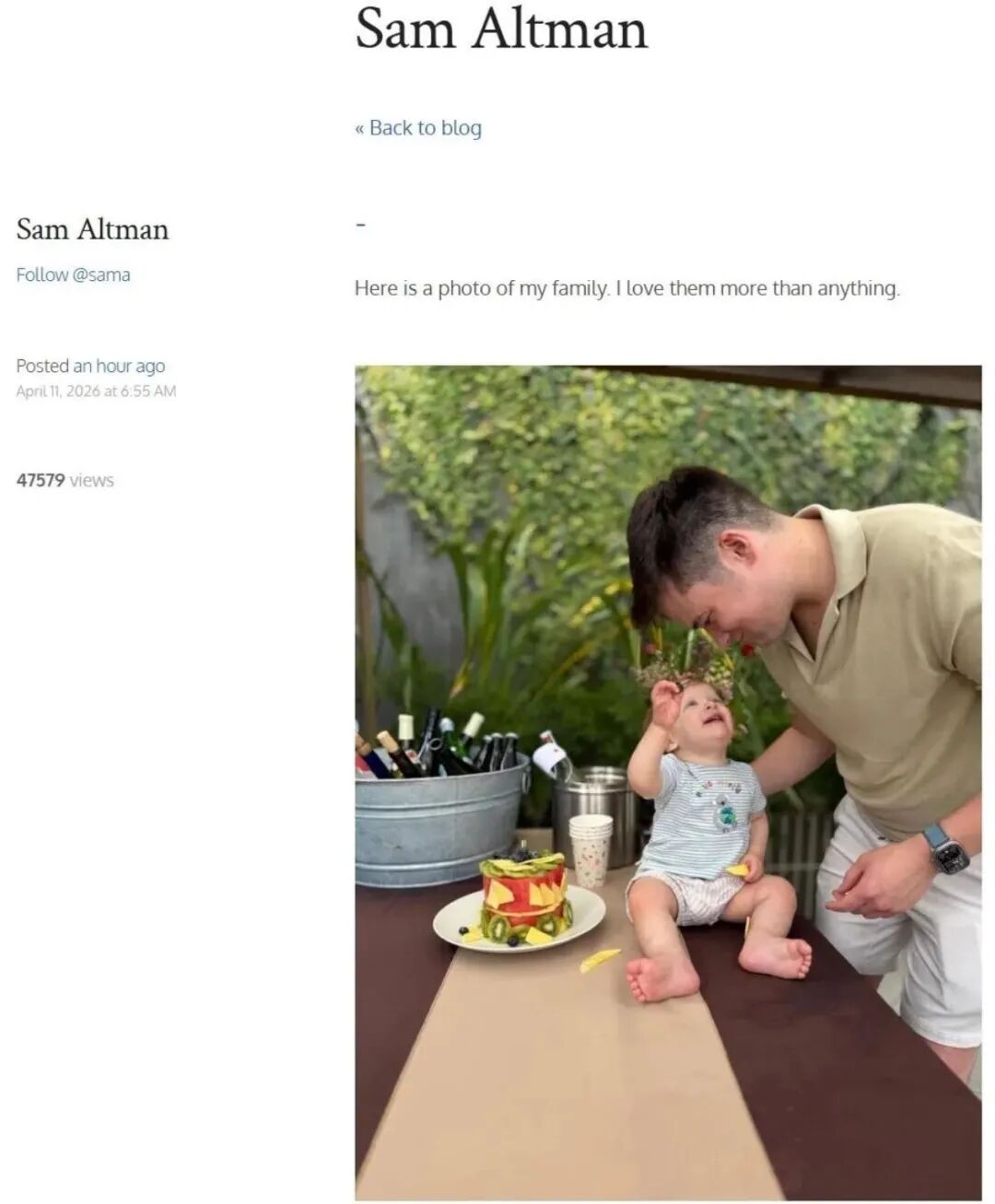

面对这起事件,奥特曼愤怒了!他罕见地公开全家福,并且深夜发表了一篇长文。

奥特曼表示,「我爱我的家人胜过一切」

在这篇文章中,奥特曼首次深刻地回应了公众对AI的极度焦虑。他坦诚这种恐惧是合理的,呼吁通过全社会的政策响应和AI民主化来应对,坚决反对少数实验室独占未来控制权。

同时,他也进行了深度的个人反思,为自己因「逃避冲突」导致董事会风波而致歉。

他犀利指出,当前AI行业频发的内部斗争,就是源于AGI犹如「魔戒」般的权力诱惑。而唯一的解法,就是不让任何人独占控制权。

最后,他呼吁各方保持理性,停止极端的言语与物理攻击。

美国民众,开始仇视AI

近几个月来,美国民众对AI的看法急剧恶化。

就在Anthropic拒绝国防部合同要求的几小时后,OpenAI宣布与五角大楼达成协议,此举招致了大量对OpenAI的恶评。

奥特曼也明白,AI在美国大众的心目中并不受欢迎,很多人认为电价上涨、大量裁员的罪魁祸首就是AI。

奥特曼的遭遇并不是首例,很多科技领袖都受过类似威胁,各大公司也都加大了对高管保护的投入。

仅在2019年,扎克伯格的安保费就超过了2000万美元。

而特斯拉提交给美国证券交易委员会的文件也透露了马斯克的安保成本:该公司「在2023年为此类安保服务支付了约240万美元的费用,并在2024年2月之前支付了约50万美元的费用,这仅仅占总成本的一部分。」

此前,美国各地就曾爆发反AI的大规模游行,愤怒的民众聚集在OpenAI和Anthropic总部外面,街道上写满标语。

3月份,就曾爆发过一场美国史上最大规模的AI全球抗议活动, 200人横跨Anthropic、OpenAI、xAI高喊 「 停止AI竞赛 」 !

总诉求只有一个:若主要 AI 实验室彼此达成一致,应承诺暂停更强大模型的训练与发布。

参与联盟包括MIRI、PauseAI、StopAI、QuitGPT等组织成员,以及部分学者与前实验室员工。

如今,AI安全派和技术加速派之间关系已经极度紧张。

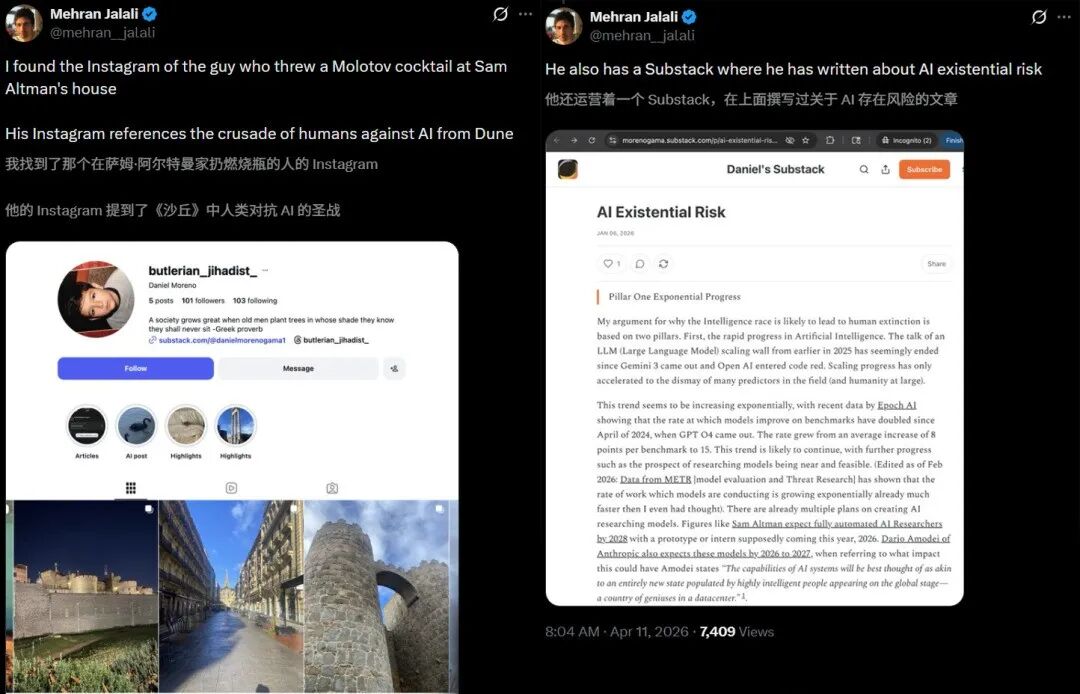

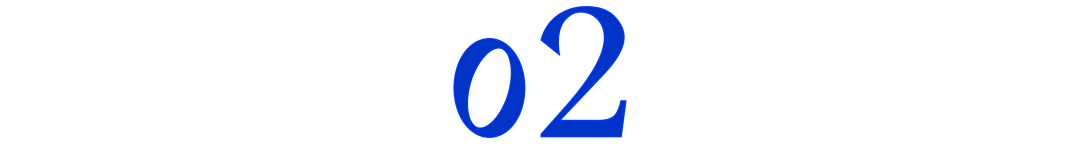

目前,扔燃烧瓶的嫌疑人被发现曾在Ins中提到《沙丘》中人类对抗AI的圣战。

奥特曼博客:AGI已成魔戒

我希望图片是有力量的。通常我们尽量保持低调私密,但在这种情况下,我决定分享一张照片,希望它能打消下一个人向我们家扔燃烧瓶的念头,不管他们对我有什么看法。

上一个人是在昨晚,凌晨3点45分干的。谢天谢地,燃烧瓶被房子的外墙弹开了,没有人受伤。

文字也是有力量的。几天前,有一篇关于我的文章,充满了火药味。昨天有人跟我说,在大家对AI感到极度焦虑的当下出这种文章,会让我的处境变得更加危险。我当时没当回事。

现在,我大半夜醒来,火很大,并且意识到我之前低估了文字和舆论导向的力量。现在看来,正是把一些事情说清楚的好时候。

首先,我的信念。

*为每个人争取繁荣、赋能全人类,以及推动科技进步,对我来说是义不容辞的道德责任。

*AI将成为人类见过的、扩展自身能力和潜力最强大的工具。人们对这个工具的需求基本上是没有上限的,大家会用它做出不可思议的事情。这个世界理应拥有海量的AI,我们必须想办法实现这一点。

*但一切不会总是一帆风顺。对AI的恐惧和焦虑是完全合理的;我们正在见证社会发生长久以来、甚至是史无前例的巨变。我们必须搞定安全问题,这不仅仅是对齐某个模型那么简单——我们迫切需要全社会的共同响应,以抵御新的威胁。这包括制定新政策,帮助我们度过艰难的经济转型期,从而走向一个美好的多的未来。

*AI必须民主化;权力绝对不能过度集中。未来的控制权属于全人类及其社会机构。AI需要在个体层面赋能每个人,同时我们需要共同为我们的未来和新规则做决定。我认为由少数几家AI实验室来决定我们未来社会形态这种最重大的事情,是不对的。

*适应性至关重要。我们都在极其快速地学习新事物;我们的一些信念会被证明是对的,有些则会是错的。有时随着技术发展和社会演变,我们需要迅速转变观念。现在还没有人真正了解超级智能的影响,但这种影响必将是极其巨大的。

其次,一些个人的反思。

回首我在OpenAI头十年的工作,有很多让我感到骄傲的事情,但也犯了一大堆错误。

我刚刚想起了我们即将与马斯克对簿公堂的事,想起了我当初是如何死守底线,拒绝同意他想要对OpenAI拥有单方面控制权的要求。我为此感到骄傲,也为我们当时在夹缝中求生,保住了OpenAI并取得随后的所有成就而感到自豪。

我不为自己害怕冲突的性格感到骄傲,这给我和OpenAI都带来了巨大的痛苦。我不为自己在与前任董事会的冲突中表现糟糕而感到骄傲,那给公司造成了巨大的烂摊子。在OpenAI疯狂的发展轨迹中,我还犯过许多其他错误;我是一个有缺陷的人,身处在一个极其复杂的局面中心,试图每年都取得一点点进步,始终为着公司的使命而工作。我们在入局之前就知道AI的赌注有多大,也知道我所关心的、心怀善意的人们之间的个人分歧会被无限放大。但亲身经历这些痛苦的冲突,并且还要经常出面调停,完全是另一回事,我们付出了惨痛的代价。我向我伤害过的人道歉,希望我当初能学得更多、更快一些。

我也非常清楚,OpenAI现在是一个大平台了,不再是当初那个草台班子般的初创公司,我们现在必须以一种更可预测、更稳定的方式运营。过去这几年,强度极大、极其混乱且压力山大。

但抛开这些,最让我自豪的是,我们正在兑现我们的使命,这在我们刚起步时看起来简直是天方夜谭。排除了万难,我们弄清楚了如何构建极其强大的AI,弄清楚了如何筹集足够的资金来建立基础设施以交付它,弄清楚了如何打造一家产品公司和商业模式,弄清楚了如何在大规模上提供相对安全和稳健的服务,还有很多很多。

很多公司都把「改变世界」挂在嘴边;但我们是真的做到了。

第三,关于这个行业的一些想法。

过去几年我个人的体会,以及我对为什么我们这个领域的公司之间会上演这么多莎士比亚戏剧般抓马事件的看法,归结起来就是一句话:「一旦你见识过通用人工智能(AGI),你就再也忘不掉了。」它带有一种真实的「魔戒」效应,能让人做出极其疯狂的事情。我不是说AGI本身就是那枚魔戒,而是那种「要成为控制AGI的那个人」的极权主义思想。

我能想到的唯一出路,就是坚定地与大众分享这项技术,不让任何人独占这枚「魔戒」。实现这一点的两个最明显的方法就是:赋能个人,以及确保民主制度始终掌握控制权。

关键在于,民主进程必须始终拥有比公司更大的权力。法律和规范肯定会改变,但我们必须在民主的框架内行事,哪怕这个过程会很混乱,而且比我们希望的要慢。我们希望成为一种发声渠道和一个利益相关者,但绝不希望拥有所有的权力。

对我们行业的许多批评,实际上源于对这项技术极高风险的真诚担忧。这是非常合理的,我们欢迎善意的批评和辩论。我对那些反技术的情绪感同身受,显然技术并不总是对每个人都有利。但总的来说,我相信技术进步能为你我的家人创造一个无比美好的未来。

在我们进行这些辩论的同时,我们应该降降温,少用点过激的言辞和手段,不管是在比喻意义上还是字面意义上,都少搞点爆炸,少炸点房子吧。

参考资料:

https://www.theverge.com/ai-artificial-intelligence/910393/openai-sam-altman-house-molotov-cocktail

https://blog.samaltman.com/2279512

https://www.businessinsider.com/sam-altman-ho me-attack-molotov-cocktail-police-arrest-2026-4

]article_adlist–>

<!-- 非定向300*250按钮 17/09 wenjing begin --> <!-- 非定向300*250按钮 end -->

</div>