来源:36氪

文 | 祥燎

编辑 | 张一驰

来源| 金错刀(ID:ijincuodao)

封面来源 | IC photo

“ 不诱于誉,不恐于诽,率道而行,端然正己。 ”

这是上周 DeepSeek-V4 发布稿的结尾, DeepSeek自己引 用的 一句话。字面意思是,不被赞誉诱惑,不被诽谤吓到,按自己认定的道往前走,端正自己。

过去一年多,同行动作频频,而 DeepSeek除了零散的更新,几乎毫无动静,继而引发不少质疑,但DeepSeek没有回应过一次。

DeepSeek淡定地做自己,英伟达却不能从容了。

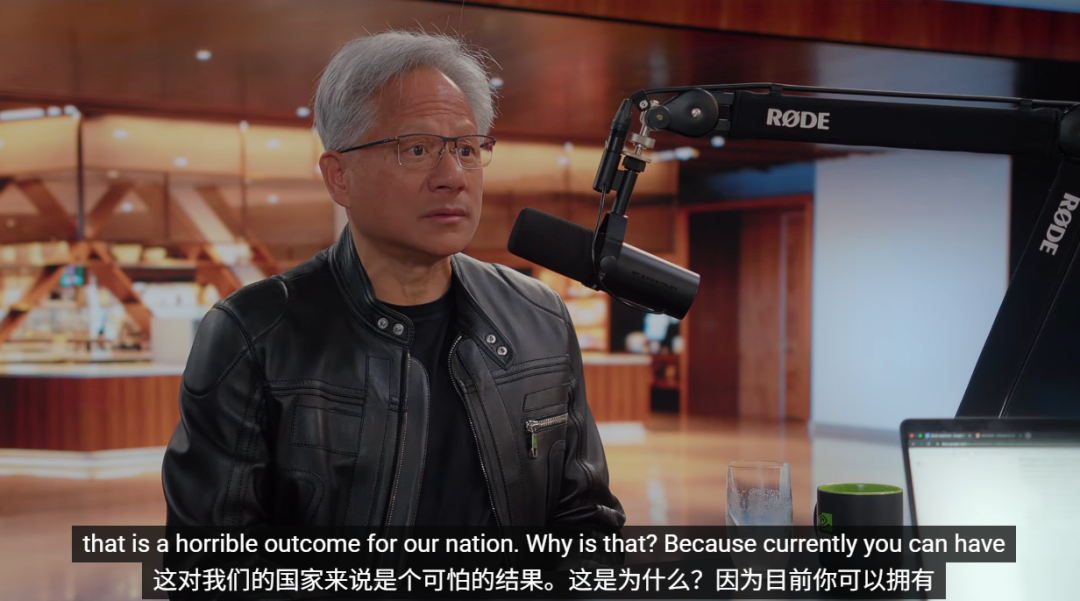

DeepSeek 已明确 表示 , V4在下半年将正式支持华为算力。 巧合的是,在此之前不久,黄仁勋在一档播客节目里提到: “如果 像 DeepSeek这样 顶尖的模型优 先 在华为芯片上运行,对 我们来说 将是 ‘可怕的后果’。”

过去两年,黄仁勋一直苦口婆心地劝告漂亮国: “如果中国不能从美国购买(高端芯片),他们就会自己建造。”

但劝告无果,他只能眼睁睁地看着 英伟达 在中国的市场份额从 2024年的70%降到2025年的55%。

接下来,黄仁勋的无奈和气愤大概率还将继续。

黄仁勋心里的意难平,

分量越来越重了

AI时代之前, 黄仁勋只是众多游戏宅眼里刀法精准的 “黄狗”。

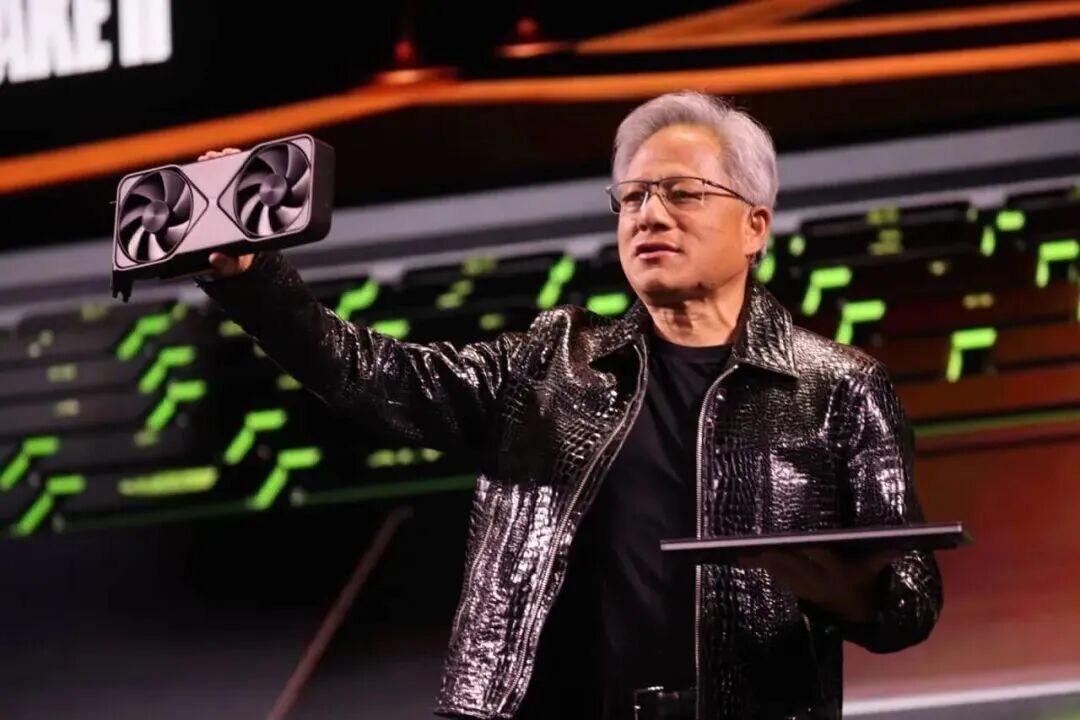

到了 AI时代,黄仁勋迎来人生巅峰,英伟达市值一路突破5万亿美元,全球第一。

逆袭背后,靠的是一次豪赌。

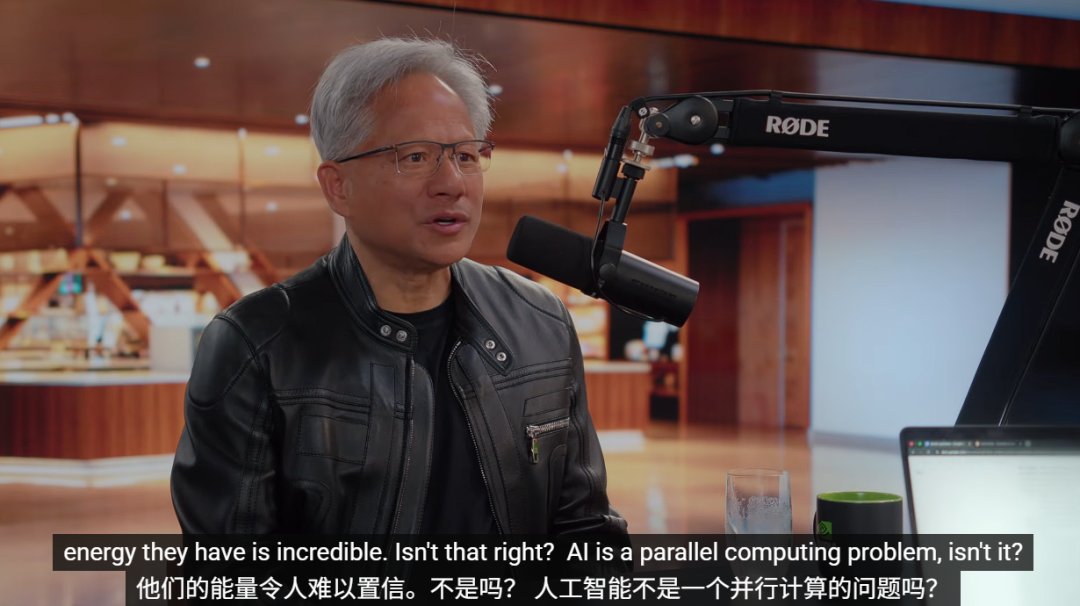

2006年,英伟达推出CUDA开发平台,能够降低GPU编程门槛,让多个GPU并行运算,从而大幅提升计算性能。

但当时除了英伟达,谁都没把它当回事。

一名英伟达深度学习团队的成员说道: “在CUDA推出十年以来,整个华尔街一直在问英伟达,为什么你们做了这项投入,却没有人使用它?他们对我们的市值估值为0美元。”

CUDA十年无人问津,英伟达 虽然 痛苦,但也获得了先发优势。

所以当 AI大潮轰然而至,英伟达一飞冲天。时至今日,英伟达的GPU更是变成了原油般的存在, 几乎所有大模型都奔跑在英伟达的算力芯片上 。

豪赌成功的黄仁勋,如今不论到哪儿都是意气风发。如果说他还有什么意难平,恐怕只有中国市场了。

黄仁勋在 2023年年底接受媒体采访时表示,中国市场占英伟达销售额的大约20%。 腾讯、阿里、字节 等巨头 的训练集群, 清一色 的英伟达 GPU 。

此外,在发展得如火如荼的中国智驾市场里,彼时有 超过 80%的 辅助 驾驶芯片 也 来自英伟达。

然而一纸禁令,彻底搅了英伟达在中国市场的美梦。

英伟达的高端芯片无法继续给中国的 AI大业添砖加瓦,后来 专门为中国市场 开发的阉割 版的 A800和H800 也没能 绕开管制 , 黄仁勋一边郁闷一边绞尽脑汁。

2023年11月,硅谷DealBook峰会上,黄仁勋在对着全息演示屏上的中国地图重申:“失去这个市场,我们没有Plan B。”

2024年1月, 黄仁勋来华,在 北京、上海、深圳三地 的 年会连轴转。上海那一场,他脱下黑皮衣,换上东北大花马甲,扭起了大秧歌 ; 11月在 港科大的讲台上 , 他又动之以理 “开放研究是全球合作的最终形式” 。

进入 2025年,黄仁勋一方面继续向中国市场示好,身着“唐装”用生硬中文赞扬中国科技发展,一边对着大洋彼岸晓之以利:“ 中国是一个不可替代的市场,服务这里符合美国的利益。 ”

可惜任凭他做足了各种姿态,说尽好赖话,还是事与愿违。

英伟达在中国市场一家独大的格局一去不复返, 华为昇腾 、 阿里平头哥 、 百度昆仑芯 和 寒武纪 , 毫不客气地瓜分了它空出来的位置。

到嘴的鸭子越飞越远,黄仁勋忍不了了。

DeepSeek-V4,

戳中英伟达的命门

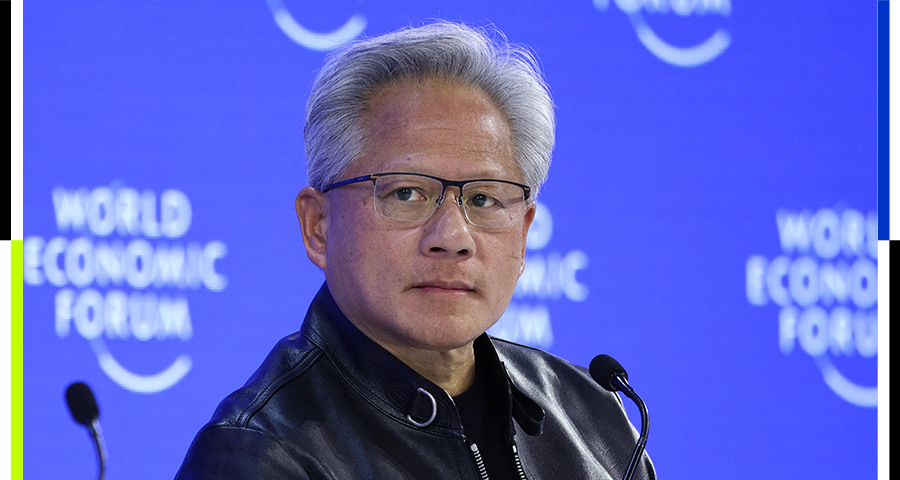

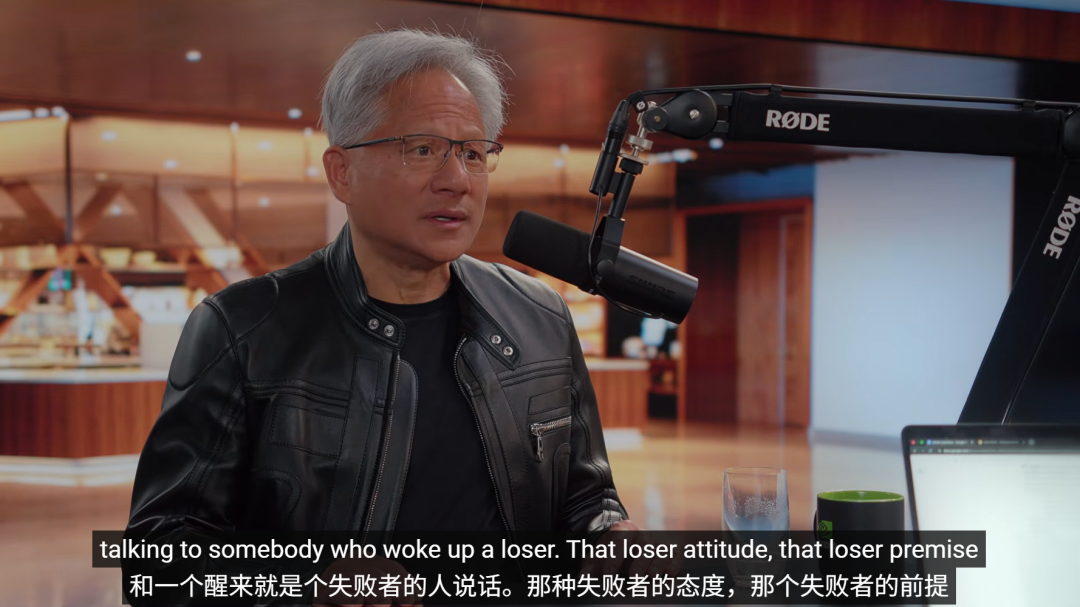

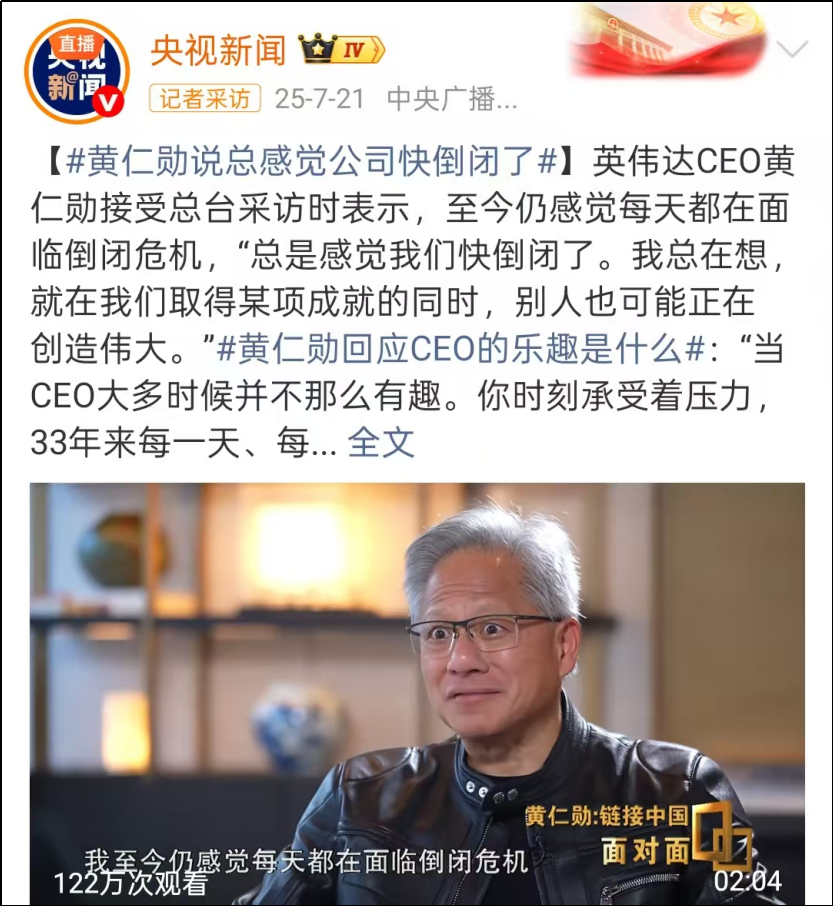

2026年4月15日,黄仁勋做客美国知名播客节目 。 面对主持人 的 一连串追问, 其中还夹带着指责他为了利益不顾国家安全的暗示,黄仁勋罕见地发飙了。

他表示, 管制的逻辑 “极其愚蠢”,是典型的“失败者心态” 。

在黄仁勋看来,如果是强者心态,一开始就不该关注要不要限制高端芯片出口。

他曾公开表示: “无论有没有美国芯片,中国的人工智能技术都在快速发展。问题不是中国是否会拥有人工智能,它已经拥有了。真正的问题是,世界上最大的人工智能市场之一是否将运行在美国的平台上。”

所以,黄仁勋 反复呼吁放开对华芯片销售 。他 不只是怕少卖几块 GPU , 更担心的是英伟达的生态地位被挑战。

一直以来,他真正在意的是 CUDA生态。

有人比喻,如果把英伟达 GPU看作“电脑主机”,CUDA就是“Windows系统”。只要该生态能让大部分人离不开,英伟达就立于不败之地。

截至 2025年,全球超过450万开发者在使用CUDA。 几乎 整个 AI圈子的人都习惯在CUDA上写代码、开发应用。 他们所有的 学习成本、项目代码、工程经验,全 都有 英伟达的印记。

要离开这个生态也不是不行 , 但那就意味着 代码重写,工具链重搭,工程师重新培训。有业内测算指出,非英伟达平台上开发周期可能延长 6个月,成本增加40%。

所谓 “卖产品不如卖品牌,卖品牌不如卖标准”,科技行业同样如此。

因此英伟达不怎么操心谁家的 AI强不强,只关心他们的AI在不在自家生态里

黄仁勋对于 DeepSeek的态度,就是一个例子。

去年 DeepSeek发布R1 , 直接冲击了行业对算力堆叠的路径依赖,业内突然意识到 原来搞顶级 AI 可能 不需要 海量 GPU , 于是英伟达股价大跌,短短三天蒸发了 6000亿美元。

但当时黄仁勋对外没有显出一点慌乱,还宣称 DeepSeek及其开源推理模型所带来的能量“令人无比兴奋”,并且笃定 这种技术创新 反而 会带来更多算力需求。

那时他确实有底气。毕竟 R1再怎么惊艳, 终究是跑在英伟达的 GPU上,活在CUDA的生态里。

DeepSeek-V4 的 出现 , 则是把他最担心的事变成了现实。

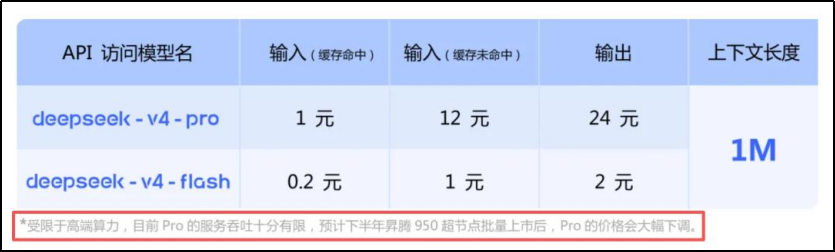

V4预览版上线 的 文档里 有 一行小字写着: “受限于高端算力,目前Pro的服务吞吐十分有限,预计下半年昇腾950超节点批量上市后,Pro的价格会大幅下调。”

言外之意是,等下半年 华为昇腾 950铺开了, V4 不但 会更流畅 ,价格 还能再砍几刀 。 V4的存在也是在告诉其他人:离开英伟达的芯片和生态,也能干 旗舰模型的活。

英伟达的生态壁垒就此裂出了一条缝,虽然还微不足道,但对于喜欢把 “英伟达离倒闭只有30天”之类的话挂嘴边的黄仁勋,不得不警惕。

“全面替代”的口号,

不是说说而已

想挑战英伟达的远不止国内企业。

2024年,AMD、英特尔、Meta、微软、谷歌等9家科技巨头成立了一个UALink联盟,针对的就是英伟达的护城河——NVLink。

OpenAI则是推出 Triton编译器 ,试图绕开 CUDA的“语言垄断”。

所以段永平曾表达过对英伟达的一个顾虑:英伟达的护城河虽然很强大,但这么多巨头针对它,不能改变一些什么吗?

对此,英伟达见招拆招,收效颇丰。 客户和竞争对手想在 NVLink之外另起炉灶 ,英伟达干脆 直接开放 NVLink ,让出一部分权限,让 客户可以把其他品牌的芯片也混进算力集群里。

中国这边全然不同,局势促使我们坚定自研,历史也反复证明了爹有娘有不如自己有,必须把英伟达从 “唯一选择”变成“备选之一”,哪怕中国的芯片在许多方面还暂时落后。

这也成了许多中国企业的共识。

科大讯飞是一个典型案例,明知迁移成本极高,用英伟达方案一个月能完成的任务,迁移到昇腾可能需要三个月,但其董事长刘庆峰直言: “这一步非走不可。”

这种不计代价的投入,大概 才是真正会让黄仁勋 头疼 的东西。

更何况,中国同行也有不少与英伟达对垒的底气。

一个是基建优势。

在播客里,主持人认为英伟达如果把高端芯片卖给中国企业,会帮助对手开发出顶尖 AI模型。黄仁勋当即反驳道, 顶尖的 AI模型,不一定要最顶尖的芯片才能训练出来。

中国企业的解决方案是 “芯海战术”,通过相关技术把 数百甚至数千颗国产芯片高速互联,形成一个庞大的算力集群,用数量优势弥补单点性能的不足 。

集群模式功耗巨大, 但好消息是,中国不缺能源。

还有市场优势。

芯片和 AI好不好用,需要在市场里验证和迭代。

中国不仅内需市场足够庞大, 中国头部 AI公司 还 普遍采用开源策略 , 大幅降低了开发者和企业的使用和二次开发门槛, 叠加成本优势, 中国 的 AI模型 能轻易 触达全球用户。

例如 2024年初,Meta的大模型Llama下载量为1060万次,而阿里的大模型Qwen下载量只有50万次。 但到了 2025年10月,Qwen的累计下载量为3.853亿次, 超过了 Llama的3.462亿次。

就像最近很火的何润东版项羽说的 “打仗靠的是决心和勇气”,挑战英伟达也需要实力、动力和决心。

还好这些我们也都不缺。

国产芯片 “ 能用 ”了,“ 好用 ” 还会远吗?

]article_adlist–>

<!-- 非定向300*250按钮 17/09 wenjing begin --> <!-- 非定向300*250按钮 end -->

</div>